Aquest article ofereix una guia pas a pas sobre l'ús de Tokenizers a Hugging Face Transformers.

Què és un Tokenizer?

Tokenizer és un concepte important de la PNL, i el seu objectiu principal és traduir el text en brut a números. Hi ha diferents tècniques i metodologies presents per a aquest propòsit. No obstant això, val la pena assenyalar que cada tècnica té un propòsit específic.

Com utilitzar els tokenitzadors a Hugging Face Transformers?

Com utilitzar els tokenitzadors a Hugging Face Transformers?

La biblioteca del tokenizer s'ha d'instal·lar primer abans d'utilitzar-la i d'importar-ne les funcions. Després d'això, entreneu un model amb AutoTokenizer i, a continuació, proporcioneu l'entrada per dur a terme la tokenització.

Hugging Face introdueix tres categories principals de tokenització que es mostren a continuació:

- Tokenitzador basat en paraules

- Tokenitzador basat en caràcters

- Tokenitzador basat en subparaules

Aquí teniu una guia pas a pas per utilitzar Tokenizers a Transformers:

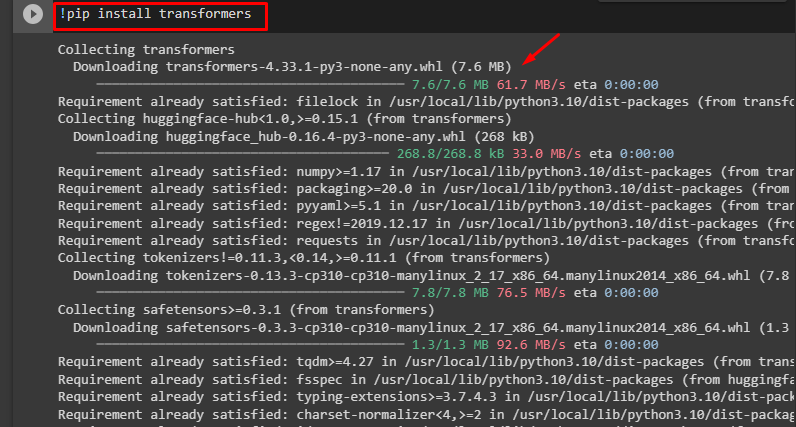

Pas 1: instal·leu els transformadors

Per instal·lar transformadors, utilitzeu l'ordre pip a l'ordre següent:

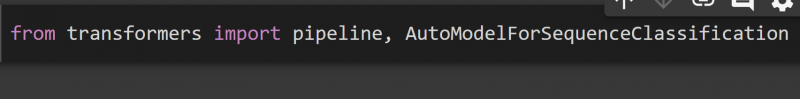

Pas 2: importa les classes

De transformadors, importació canonada , i AutoModelForSequenceClassification biblioteca per realitzar la classificació:

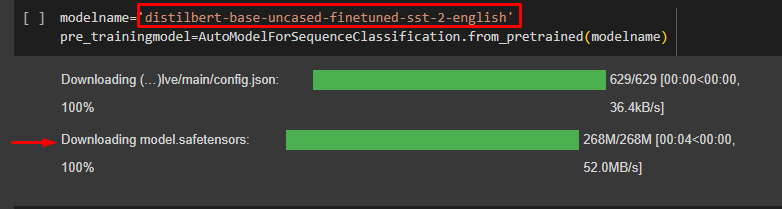

Pas 3: importa el model

El ' AutoModelForSequenceClassification ” és un mètode que pertany a Auto-Class per a la tokenització. El des de_preentrenat() s'utilitza per retornar la classe de model correcta en funció del tipus de model.

Aquí hem proporcionat el nom del model a la ' nom del model ” variable:

nom del model = 'distilbert-base-uncased-finetuned-sst-2-anglés'model pre_formació =AutoModelForSequenceClassification.from_pretrained ( nom del model )

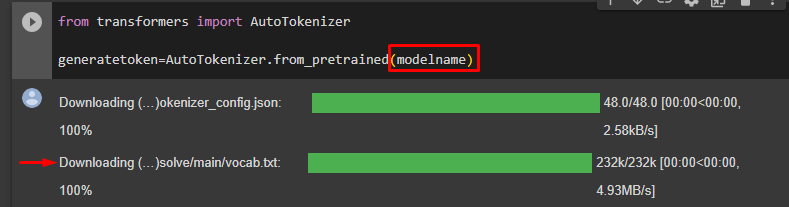

Pas 4: importeu AutoTokenizer

Proporcioneu l'ordre següent per generar fitxes passant el ' nom del model ” com l'argument:

el testimoni generat =AutoTokenizer.from_pretrained ( nom del model )

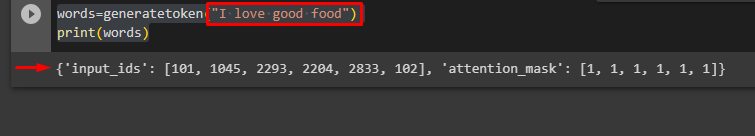

Pas 5: genera un testimoni

Ara, generarem fitxes en una frase “M'encanta el bon menjar” utilitzant el ' el testimoni generat ” variable:

imprimir ( paraules )

La sortida es dóna de la següent manera:

El codi de l'anterior Google Co es dóna aquí.

Conclusió

Per utilitzar Tokenizers a Hugging Face, instal·leu la biblioteca mitjançant l'ordre pip, entreneu un model amb AutoTokenizer i, a continuació, proporcioneu l'entrada per dur a terme la tokenització. Mitjançant la tokenització, assigneu pesos a les paraules en funció de les quals s'ordenen per retenir el significat de la frase. Aquesta puntuació també determina el seu valor per a l'anàlisi. Aquest article és una guia detallada sobre com utilitzar Tokenizers a Hugging Face Transformers.