En aquest bloc, tractarem el contingut que s'ofereix a continuació:

- Com personalitzar la generació de text carregant el model amb la funció 'pipeline' de Transformers?

- Com utilitzar un model basat en transformadors per generar text a PyTorch?

- Com utilitzar un model basat en transformadors per generar text a TensorFlow?

Com personalitzar la generació de text carregant el model amb la funció 'pipeline' de Transformers?

El ' canonada La funció s'utilitza per descarregar automàticament el model d'IA pre-entrenat segons els requisits de l'usuari. Per utilitzar aquesta funció en particular, els usuaris han d'instal·lar el ' transformadors ” paquets. Aquest paquet dóna accés a models d'última generació basats en Transformer que poden realitzar anàlisis de sentiments i altres Processament del llenguatge natural (PNL) tasques.

Per veure la demostració pràctica de l'escenari descrit anteriorment, aneu als passos que s'indiquen a continuació!

Pas 1: instal·leu paquets 'transformadors'.

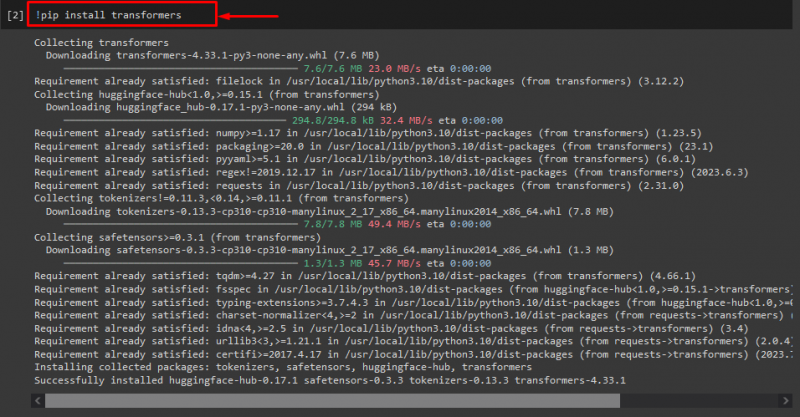

Inicialment, executeu el '! pip” comanda per instal·lar els paquets del transformador:

! transformadors d'instal·lació de pip

Com podeu veure, el paquet especificat s'ha instal·lat correctament:

Pas 2: importa el model basat en transformadors

A continuació, importeu el model basat en el transformador necessari. Per fer-ho, primer, importeu el ' canonada ” funció de “ transformadors ”. A continuació, utilitzeu la funció importada i passeu el ' generació de textos ' com a argument per a això juntament amb el nom del model requerit ' gpt2 ”. A continuació, passeu-los al ' generar ” variable:

des de transformadors importar canonada

generar = canonada ( 'generació de text' , model = 'gpt2' )

Pas 3: genereu text personalitzat

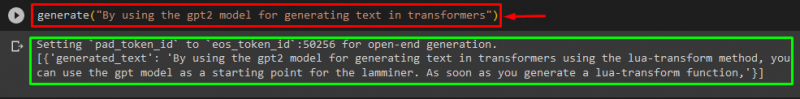

Ara, passa el text desitjat com a argument al ' generar ”. Com es mostra a continuació:

generar ( 'Utilitzant el model gpt2 per generar text en transformadors' )Segons la sortida proporcionada, el 'preentrenat' descarregat gpt3 ” el model s'ha generat text correctament:

També podeu utilitzar els altres arguments, com ara:

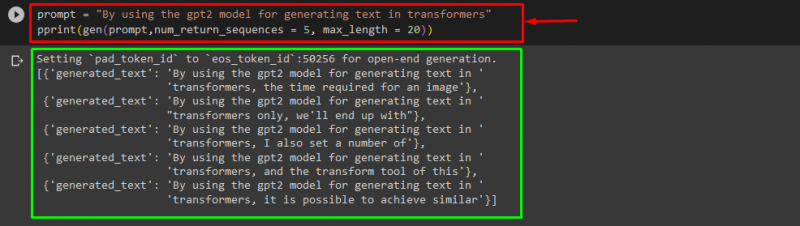

prompte = 'Utilitzant el model gpt2 per generar text en transformadors'imprimir ( gen ( prompte , num_return_sequences = 5 , longitud_màx = 20 ) )

Aquí:

- “ prompte ” s'utilitza com a argument que manté l'entrada.

- “ num_return_sequence ” s'utilitza per generar el nombre de seqüències del text proporcionat.

- “ longitud_màx ” s'utilitza per especificar la longitud del text generat. En el nostre cas, es limita a ' 30 ” fitxes (paraules o puntuació):

Nota: El text personalitzat serà una continuació de la sol·licitud especificada que es basa en les dades d'entrenament del model.

Com utilitzar un model basat en transformadors per generar text a PyTorch?

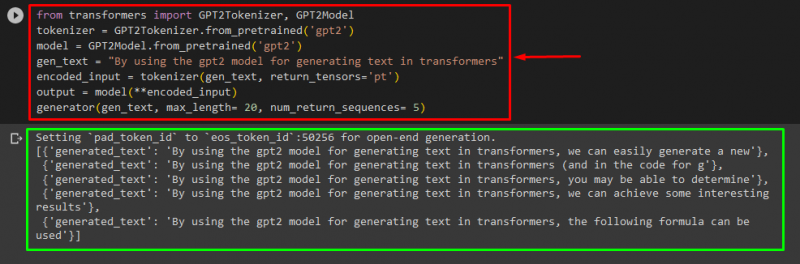

Els usuaris també poden personalitzar el text a ' PyTorch ' que és ' Torxa marc d'aprenentatge automàtic basat. S'utilitza per a diferents aplicacions, com ara PNL i visió per ordinador. Per utilitzar el model basat en transformadors per personalitzar el text a PyTorch, primer, importeu el ' GPT2Tokenizer ' i ' Model GPT2 ” funcions de la “ transformadors ”:

des de transformadors importar GPT2Tokenizer , Model GPT2A continuació, utilitzeu el ' GPT2Tokenizer 'tokenitzador segons el nostre model pre-entrenat desitjat anomenat ' gpt2 ”:

tokenitzador = GPT2Tokenizer. de_preentrenat ( 'gpt2' )Després, instanciant els pesos d'un model pre-entrenat:

model = Model GPT2. de_preentrenat ( 'gpt2' )A continuació, declara un ' text_gen ” variable que conté el text que volem personalitzar:

text_gen = 'Utilitzant el model gpt2 per generar text en transformadors'Ara, passa el ' text_gen ' i ' return_tensors = 'pt' ' com a argument que generarà el text a PyTorch i emmagatzemarà el valor generat al ' entrada_codificada ” variable:

entrada_codificada = tokenitzador ( text_gen , retorn_tensors = 'pt' )Finalment, passa el ' entrada_codificada ” variable que conté el text personalitzat al “ model ” com a paràmetre i obteniu la sortida resultant utilitzant el “ longitud_màx ' argument que està establert en ' 20 ” que indica que el text generat es limitarà a uns testimonis proporcionats, el “ num_return_sequences 'que s'estableix en' 5 ” que mostra que el text generat es basarà en 5 seqüències de text:

sortida = model ( **entrada_codificada )generador ( text_gen , longitud_màx = 20 , num_return_sequences = 5 )

Sortida

Com utilitzar un model basat en transformadors per generar text a TensorFlow?

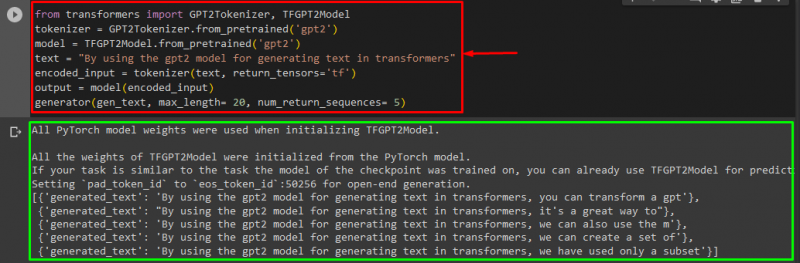

Per generar el text a Transformers, el ' TensorFlow També s'utilitzen marcs d'aprenentatge automàtic basats en ”. Per fer-ho, primer, importeu les funcions necessàries, com ara ' GPT2Tokenizer ' i ' TFGPT2Model ' de la ' transformadors ”. La resta del codi és el mateix que l'anterior, només fem servir el ' TFGPT2Model ” funció en lloc de “ Model GPT2 ” funció. Com segueix:

des de transformadors importar GPT2Tokenizer , TFGPT2Modeltokenitzador = GPT2Tokenizer. de_preentrenat ( 'gpt2' )

model = TFGPT2Model. de_preentrenat ( 'gpt2' )

text = 'Utilitzant el model gpt2 per generar text en transformadors'

entrada_codificada = tokenitzador ( text , retorn_tensors = 'tf' )

sortida = model ( entrada_codificada )

generador ( text_gen , longitud_màx = 20 , num_return_sequences = 5 )

Com podeu veure, el text personalitzat s'ha generat correctament:

Això és! Hem treballat sobre la personalització de la generació de text a Transformers.

Conclusió

Per personalitzar la generació de text a Transformers, hi ha diferents maneres, com ara carregar el model amb la funció de canalització, utilitzant el model basat en transformadors a ' PyTorch ' i ' TensorFlow ” que es basen en marcs d'aprenentatge automàtic. En aquesta guia, hem proporcionat informació breu juntament amb una demostració pràctica de personalitzar la generació de text a Transformers.