LangChain és el marc que conté múltiples dependències i biblioteques que es poden utilitzar per construir grans models de llenguatge. Aquests models es poden utilitzar per interactuar amb humans, però primer, el model ha d'aprendre a obtenir/entendre el missatge/pregunta que fa l'ésser humà. Per a això, el model s'ha d'entrenar a les plantilles de sol·licitud i després l'usuari fa la pregunta dins de la plantilla donada.

Aquesta guia il·lustrarà el procés de creació de plantilles d'indicadors a LangChain.

Com crear plantilles de sol·licitud a LangChain?

Per crear plantilles d'indicacions a LangChain, només cal que aneu a la guia següent amb diversos passos:

Pas 1: instal·leu mòduls i configureu l'entorn

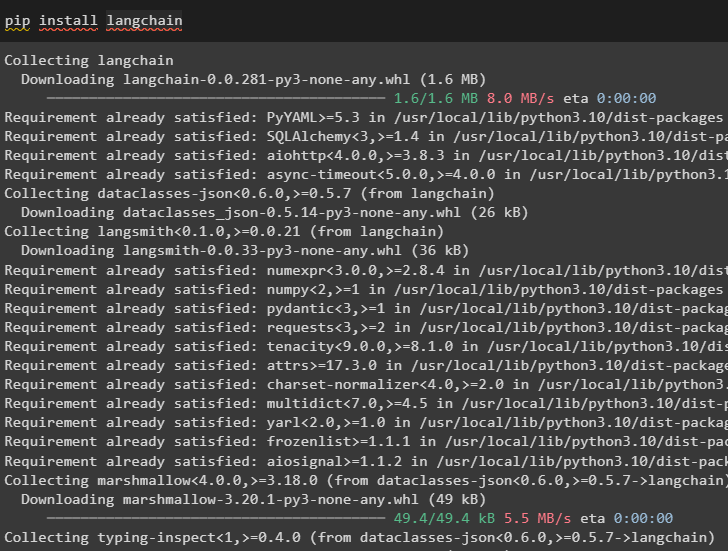

Inicieu el procés de creació de plantilles d'indicadors a LangChain instal·lant el marc de LangChain:

pip install langchain

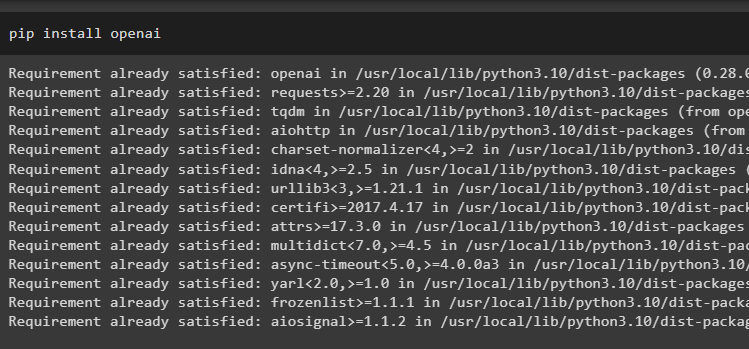

Ara, instal·leu els mòduls OpenAI per accedir a les seves biblioteques i establiu un entorn utilitzant-lo:

pip install openai

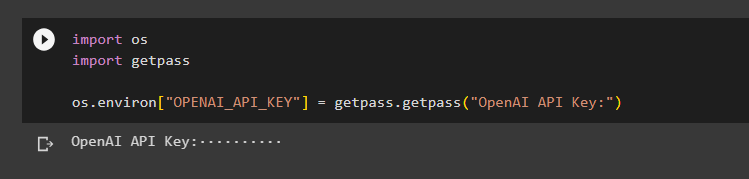

Configura el Entorn OpenAI utilitzant la biblioteca del sistema operatiu per accedir al sistema operatiu i proporcionar la clau de l'API OpenAI:

importa'nsimportar getpass

os.environ['OPENAI_API_KEY'] = getpass.getpass('Clau de l'API OpenAI:')

Pas 2: Ús de la plantilla de sol·licitud

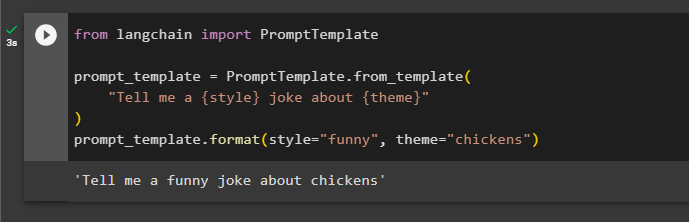

Després d'instal·lar LangChain, simplement importeu la biblioteca PromptTemplate i creeu una plantilla per a la consulta sobre una broma amb alguns aspectes addicionals com a variables com l'adjectiu, el contingut, etc.:

de langchain import PromptTemplateprompt_template = PromptTemplate.from_template(

'Explica'm una broma d'{estil} sobre {tema}'

)

prompt_template.format(style='divertit', theme='pollastres')

L'indicador s'ha establert i donat al model amb els valors de la variable inserits a l'ordre:

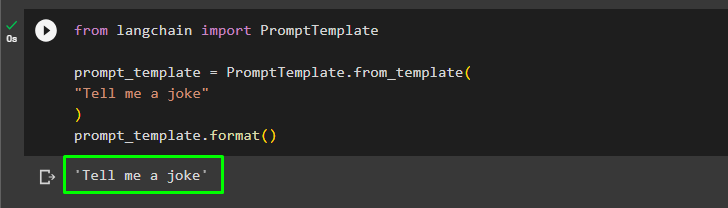

L'usuari pot personalitzar la plantilla de sol·licitud amb una simple consulta demanant una broma:

de langchain import PromptTemplateprompt_template = PromptTemplate.from_template(

'Explica'm una broma'

)

prompt_template.format()

El mètode anterior és per a una sola consulta i resposta, però de vegades l'usuari vol interactuar amb el model en forma de xat i la següent secció explica el seu format.

Pas 3: ús de la plantilla de sol·licitud de xat

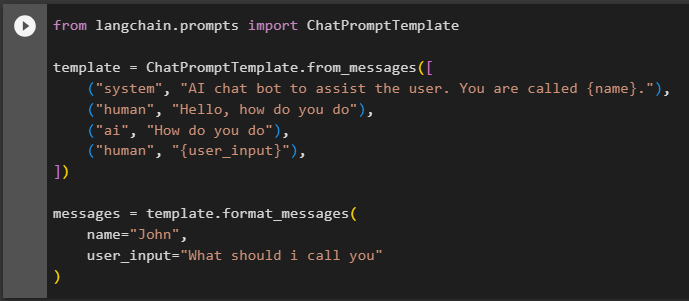

Aquesta secció explica la plantilla per a un model de xat que es basa en un patró de conversa com dos humans interactuant entre ells:

de langchain.prompts importar ChatPromptTemplateplantilla = ChatPromptTemplate.from_messages([

('sistema', 'Bot de xat AI per ajudar l'usuari. Et diuen {nom}.')

('humà', 'Hola, com et va'),

('ai', 'Com et va'),

('humà', '{user_input}'),

])

missatges = template.format_messages(

nom = 'Joan',

user_input='Com t'he de dir'

)

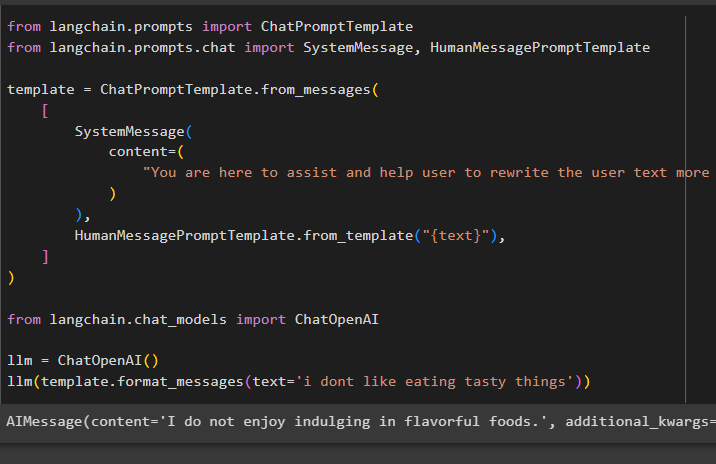

Després de configurar l'estructura de la plantilla, simplement escriviu algunes línies al text per dir-li al model què s'espera d'ell i utilitzeu la funció llm() per donar una indicació:

de langchain.prompts importar ChatPromptTemplatede langchain.prompts.chat import SystemMessage, HumanMessagePromptTemplate

template = ChatPromptTemplate.from_messages(

[

Missatge del sistema(

contingut=(

'Esteu aquí per ajudar i ajudar l'usuari a reescriure el text de l'usuari de manera més eficaç'

)

),

HumanMessagePromptTemplate.from_template('{text}'),

]

)

des de langchain.chat_models importar ChatOpenAI

llm = ChatOpenAI()

llm(template.format_messages(text='no m'agrada menjar coses gustoses'))

El mètode SystemMessage() conté el contingut de la resposta per a la consulta utilitzada al LLM:

Es tracta de crear plantilles d'indicadors a LangChain.

Conclusió

Per crear una plantilla de sol·licitud a LangChain, només cal que instal·leu els mòduls LangChain i OpenAI per configurar un entorn mitjançant la clau de l'API OpenAI. Després d'això, creeu una plantilla de sol·licitud per a un sol missatge, com ara demanar una broma o una sola pregunta sobre qualsevol cosa. Un altre mètode és personalitzar una plantilla per a un model de xat basat en el procés d'interacció entre dos humans diferents. Aquesta publicació ha il·lustrat el procés de creació d'una plantilla d'indicadors a LangChain.